很可惜 T 。T 您现在还不是作者身份,不能自主发稿哦~

如有投稿需求,请把文章发送到邮箱tougao@appcpx.com,一经录用会有专人和您联系

咨询如何成为春羽作者请联系:鸟哥笔记小羽毛(ngbjxym)

不少时候,一篇文章能否得到广泛的传播,除了文章本身实打实的质量以外,一个好的标题也至关重要。本文爬取了虎嗅网建站至今共 5 万条新闻标题内容,助你找到起文章标题的技巧与灵感。同时,分享一些值得关注的文章和作者。

在众多新媒体网站中,「虎嗅」网的文章内容和质量还算不错。在「新榜」科技类公众号排名中,它位居榜单第 3 名,还是比较受欢迎的。所以选择爬取该网站的文章信息,顺便从中了解一下这几年科技互联网都出现了哪些热点信息。

分析虎嗅网 5 万篇文章的基本情况,包括收藏数、评论数等

发掘最受欢迎和最不受欢迎的文章及作者

分析文章标题形式(长度、句式)与受欢迎程度之间的关系

展现近些年科技互联网行业的热门词汇

Python 3.6

pyspider

MongoDB

Matplotlib

WordCloud

Jieba

使用 pyspider 抓取了虎嗅网的主页文章,文章抓取时期为 2012 年建站至 2018 年 11 月 1 日,共计约 5 万篇文章。抓取 了 7 个字段信息:文章标题、作者、发文时间、评论数、收藏数、摘要和文章链接。

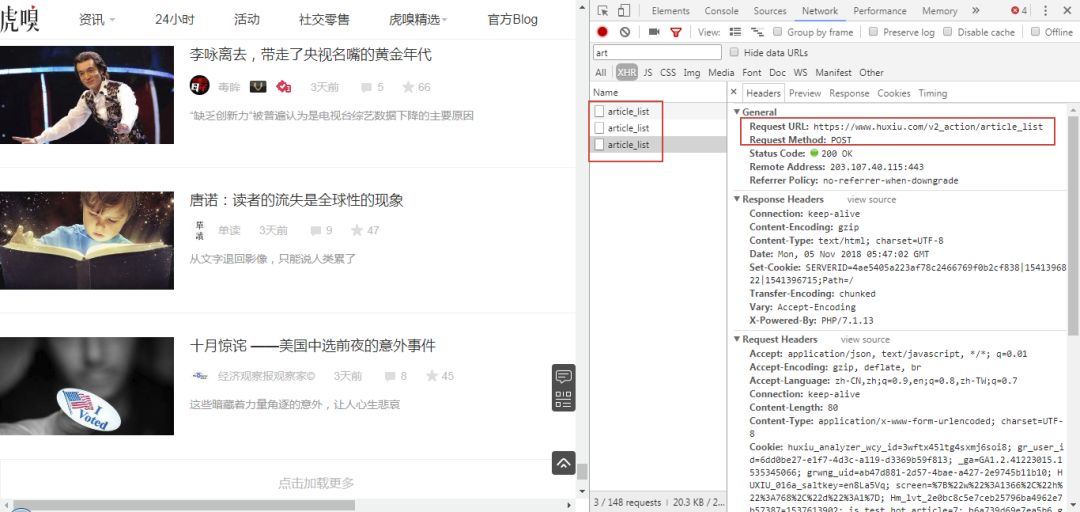

这是要爬取的 网页界面,可以看到是通过 AJAX 加载的。

右键打开开发者工具查看翻页规律,可以看到 URL 请求是 POST 类型,下拉到底部查看 Form Data,表单需提交参数只有 3 项。经尝试, 只提交 page 参数就能成功获取页面的信息,其他两项参数无关紧要,所以构造分页爬取非常简单。

1huxiu_hash_code: 39bcd9c3fe9bc69a6b682343ee3f024a

2page: 4

3last_dateline: 1541123160

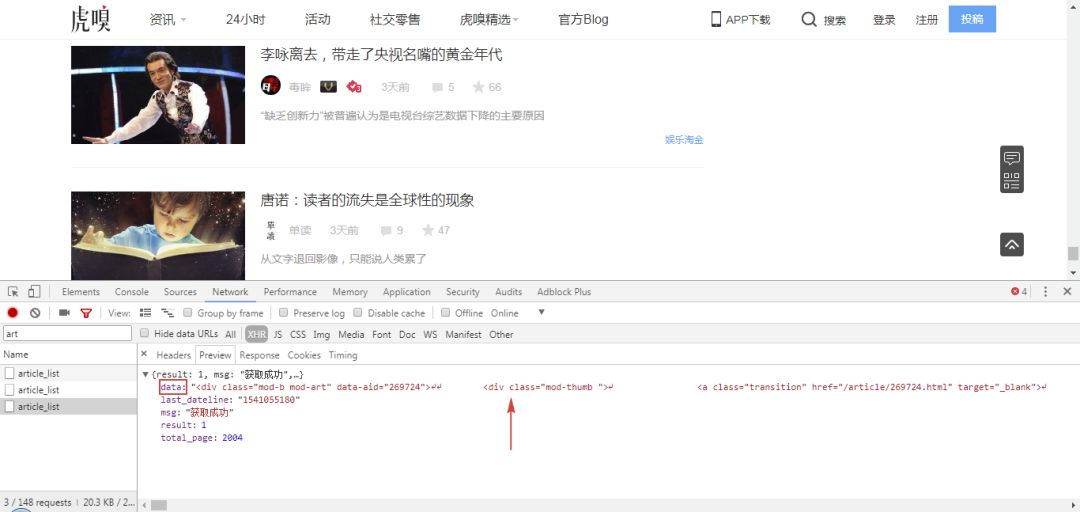

接着,切换选项卡到 Preview 和 Response 查看网页内容,可以看到数据都位于 data 字段里。total_page 为 2004,表示一共有 2004 页的文章内容,每一页有 25 篇文章,总共约 5 万篇,也就是我们要爬取的数量。

以上,我们就找到了所需内容,接下来可以开始构造爬虫,整个爬取思路比较简单。之前我们也练习过这一类 Ajax 文章的爬取,可以参考:

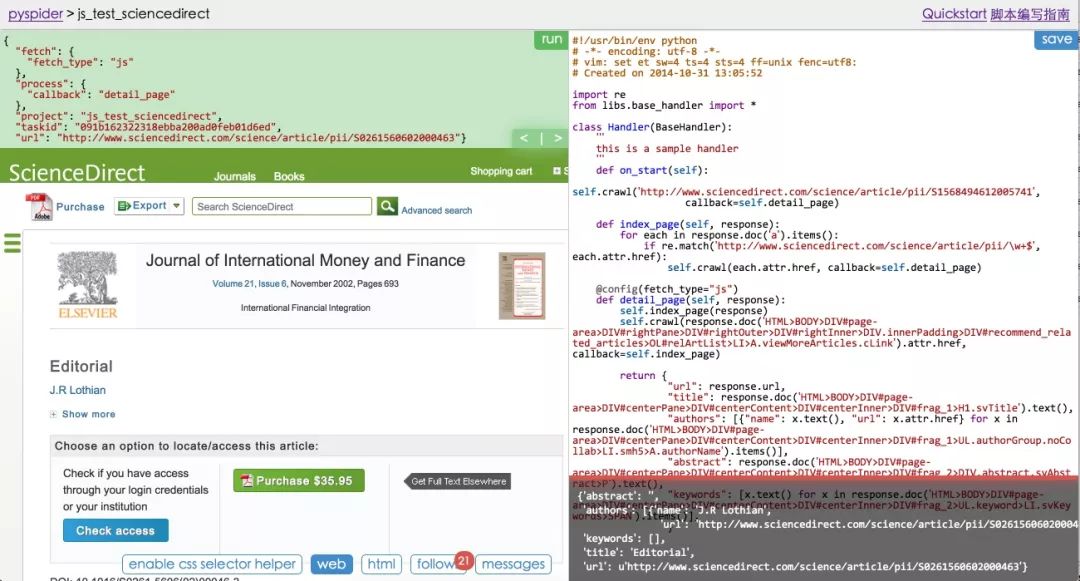

和之前文章(《以虎嗅网4W篇文章为例,展现数据分析全流程》)不同的是,这里我们使用一种新的工具来进行爬取,叫做:pyspider 框架。由国人 binux 大神开发,GitHub Star 数超过 12 K,足以证明它的知名度。可以说,学习爬虫不能不会使用这个框架。

网上关于这个框架的介绍和实操案例非常多,这里仅简单介绍一下。

我们之前的爬虫都是在 Sublime 、PyCharm 这种 IDE 窗口中执行的,整个爬取过程可以说是处在黑箱中,内部运行的些细节并不太清楚。而 pyspider 一大亮点就在于提供了一个可视化的 WebUI 界面,能够清楚地查看爬虫的运行情况。

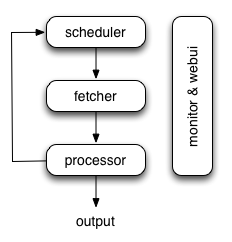

pyspider 的架构主要分为 Scheduler(调度器)、Fetcher(抓取器)、Processer(处理器)三个部分。Monitor(监控器)对整个爬取过程进行监控,Result Worker(结果处理器)处理最后抓取的结果。

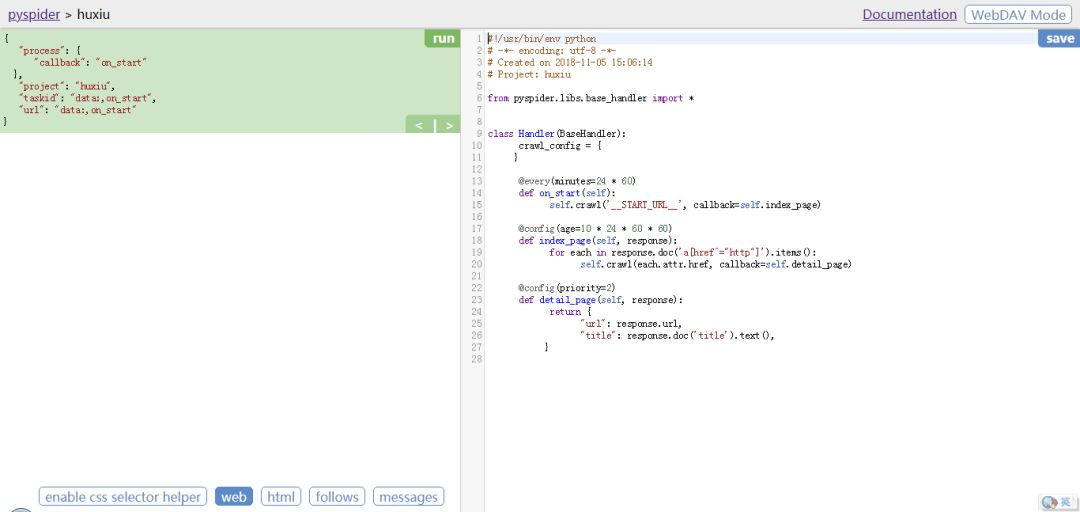

该框架比较容易上手,网页右边是代码区,先定义类(Class)然后在里面添加爬虫的各种方法(也可以称为函数),运行的过程会在左上方显示,左下方则是输出结果的区域。

这里,分享几个不错的教程以供参考:

官方主页:http://docs.pyspider.org/en/latest/

pyspider 爬虫原理剖析:http://python.jobbole.com/81109/

pyspider 爬淘宝图案例实操:https://cuiqingcai.com/2652.html

安装好该框架并大概了解用法后,下面我们可以就开始爬取了。

CMD 命令窗口执行:pyspider all 命令,然后浏览器输入:http://localhost:5000/ 就可以启动 pyspider 。

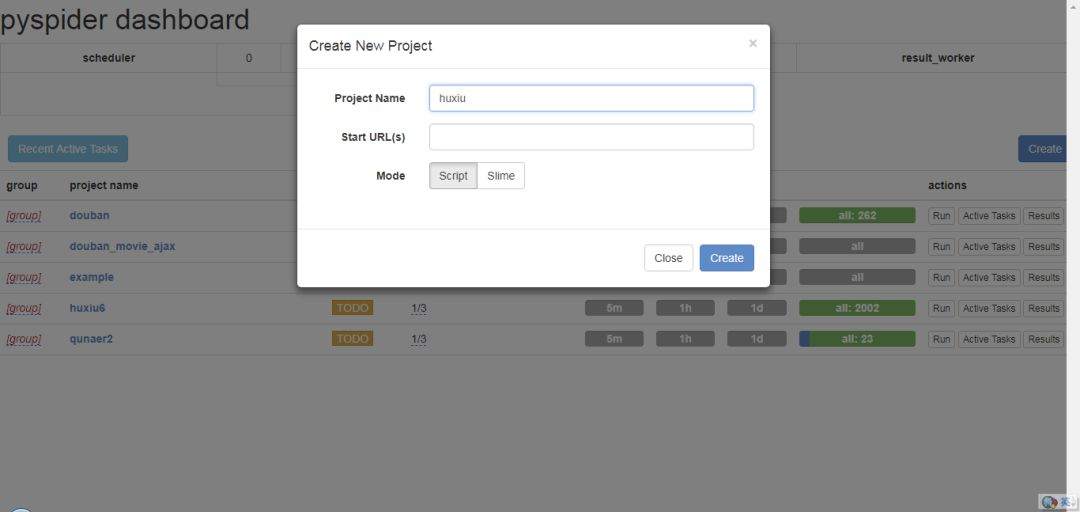

点击 Create 新建一个项目,Project Name 命名为:huxiu,因为要爬取的 URL 是 POST 类型,所以这里可以先不填写,之后可以在代码中添加,再次点击 Creat 便完成了该项目的新建。

新项目建立好后会自动生成一部分模板代码,我们只需在此基础上进行修改和完善,然后就可以运行爬虫项目了。现在,简单梳理下代码编写步骤。

1from pyspider.libs.base_handler import *

2class Handler(BaseHandler):

3 crawl_config:{

4 "headers":{

5 'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; WOW64)

AppleWebKit/537.36 (KHTML, like Gecko) Chrome/66.0.3359.181 Safari/537.36',

6 'X-Requested-With': 'XMLHttpRequest'

7 }

8 }

9 def on_start(self):

10 for page in range(2,3): # 先循环1页

11 print('正在爬取第 %s 页' % page)

12 self.crawl('

data={'page':page}, callback=self.index_page)这里,首先定义了一个 Handler 主类,整个爬虫项目都主要在该类下完成。 接着,可以将爬虫基本的一些基本配置,比如 Headers、代理等设置写在下面的 crawl_config 属性中。

如果你还没有习惯从函数(def)转换到类(Class)的代码写法,那么需要先了解一下类的相关知识,之后我也会单独用一篇文章介绍一下。

下面的 on_start() 方法是程序的入口,也就是说程序启动后会首先从这里开始运行。首先,我们将要爬取的 URL传入 crawl() 方法,同时将 URL 修改成虎嗅网的:https://www.huxiu.com/v2_action/article_list。

由于 URL 是 POST 请求,所以我们还需要增加两个参数:method 和 data。method 表示 HTTP 请求方式,默认是 GET,这里我们需要设置为 POST;data 是 POST 请求表单参数,只需要添加一个 page 参数即可。

接着,通过 callback 参数定义一个 index_page() 方法,用来解析 crawl() 方法爬取 URL 成功后返回的 Response 响应。在后面的 index_page() 方法中,可以使用 PyQuery 提取响应中的所需内容。具体提取方法如下:

1import json

2from pyquery import PyQuery as pq

3def index_page(self, response):

4 content = response.json['data']

5 # 注意,在sublime中,json后面需要添加(),pyspider 中则不用

6 doc = pq(content)

7 lis = doc('.mod-art').items()

8 data = [{

9 'title': item('.msubstr-row2').text(),

10 'url':'https://www.huxiu.com'+ str(item('.msubstr-row2').attr('href')),

11 'name': item('.author-name').text(),

12 'write_time':item('.time').text(),

13 'comment':item('.icon-cmt+ em').text(),

14 'favorites':item('.icon-fvr+ em').text(),

15 'abstract':item('.mob-sub').text()

16 } for item in lis ] # 列表生成式结果返回每页提取出25条字典信息构成的list

17 print(data)

18 return data

这里,网页返回的 Response 是 json 格式,待提取的信息存放在其中的 data 键值中,由一段 HTML 代码构成。我们可以使用 response.json['data'] 获取该 HTML 信息,接着使用 PyQuery 搭配 CSS 语法提取出文章标题、链接、作者等所需信息。这里使用了列表生成式,能够精简代码并且转换为方便的 list 格式,便于后续存储到 MongoDB 中。

我们输出并查看一下第 2 页的提取结果:

1# 由25个 dict 构成的 list

2[{'title': '想要长生不老?杀死体内的“僵尸细胞”吧', 'url': 'https://www.huxiu.com/article/270086.html', 'name': '造就Talk', 'write_time': '19小时前', 'comment': '4', 'favorites': '28', 'abstract': '如果有了最终疗法,也不应该是每天都需要接受治疗'},

3 {'title': '日本步入下流社会,我们还在买买买', 'url': 'https://www.huxiu.com/article/270112.html', 'name': '腾讯《大家》©', 'write_time': '20小时前', 'comment': '13', 'favorites': '142', 'abstract': '我买,故我在'}

4...

5]

可以看到,成功得到所需数据,然后就可以保存了,可以选择输出为 CSV、MySQL、MongoDB 等方式,这里我们选择保存到 MongoDB 中。

1import pandas as pd

2import pymongo

3import time

4import numpy as np

5client = pymongo.MongoClient('localhost',27017)

6db = client.Huxiu

7mongo_collection = db.huxiu_news

8

9def on_result(self,result):

10 if result:

11 self.save_to_mongo(result)

12def save_to_mongo(self,result):

13 df = pd.DataFrame(result)

14 #print(df)

15 content = json.loads(df.T.to_json()).values()

16 if mongo_collection.insert_many(content):

17 print('存储到 mongondb 成功')

18 # 随机暂停

19 sleep = np.random.randint(1,5)

20 time.sleep(sleep)

上面,定义了一个 on_result() 方法,该方法专门用来获取 return 的结果数据。这里用来接收上面 index_page() 返回的 data 数据,在该方法里再定义一个存储到 MongoDB 的方法就可以保存到 MongoDB 中。

关于数据如何存储到 MongoDB 中,我们在之前的一篇文章中有过介绍,如果忘记了可以回顾一下。

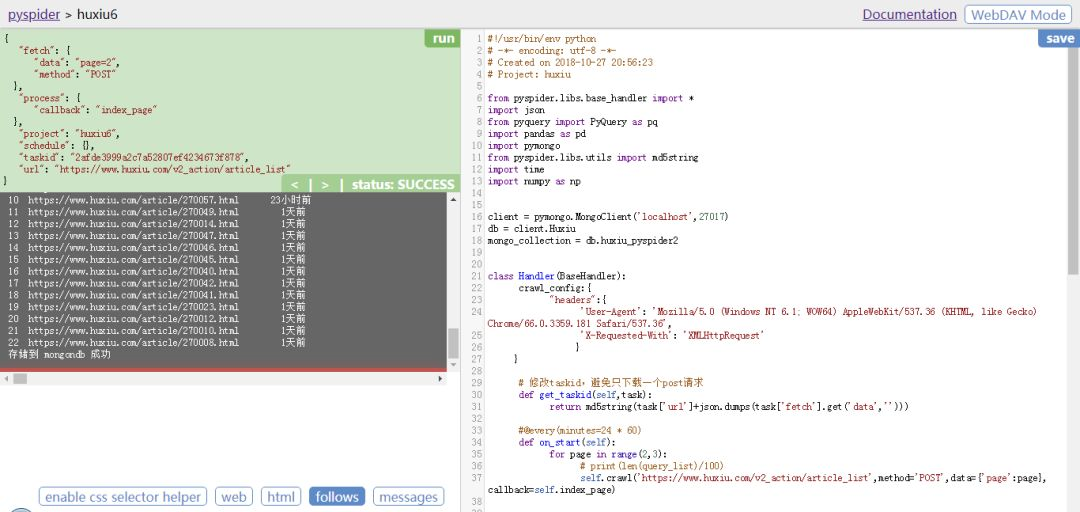

下面,我们来测试一下整个爬取和存储过程。点击左上角的 run 就可以顺利运行单个网页的抓取、解析和存储,结果如下:

上面完成了单页面的爬取,接下来,我们需要爬取全部 2000 余页内容。

需要修改两个地方,首先在 on_start() 方法中将 for 循环页数 3 改为 2002。改好以后,如果我们直接点击 run ,会发现还是只能爬取第 2 页的结果。

这是因为,pyspider 以 URL的 MD5 值作为 唯一 ID 编号,ID 编号相同的话就视为同一个任务,便不会再重复爬取。由于 GET 请求的 分页URL 通常是有差异的,所以 ID 编号会不同,也就自然能够爬取多页。但这里 POST 请求的分页 URL 是相同的,所以爬完第 2 页,后面的页数便不会再爬取。

那有没有解决办法呢? 当然是有的,我们需要重新写下 ID 编号的生成方式,方法很简单,在 on_start() 方法前面添加下面 2 行代码即可:

1def get_taskid(self,task):

2 return md5string(task['url']+json.dumps(task['fetch'].get('data','')))

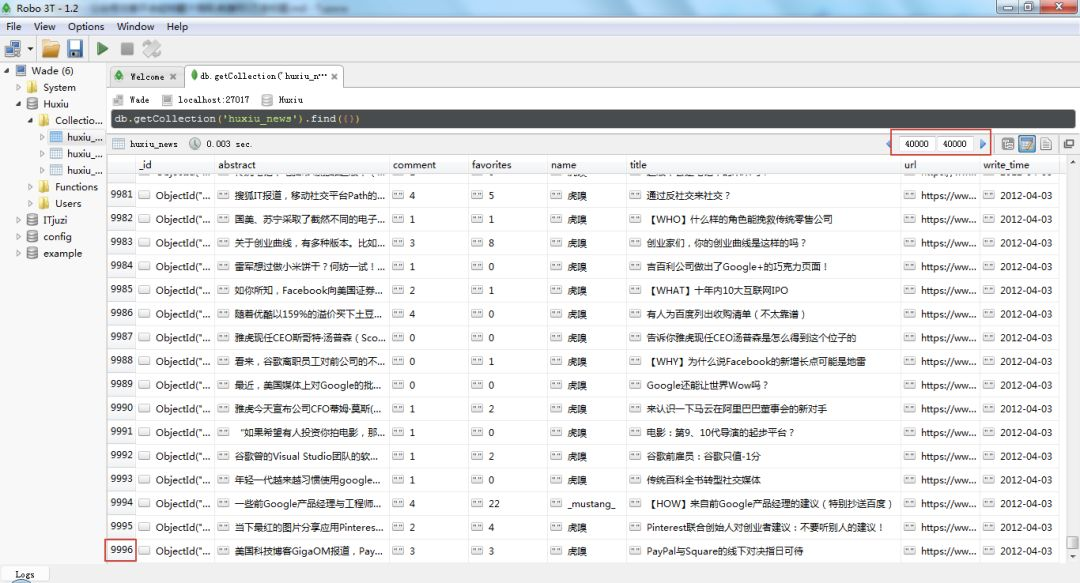

这样,我们再点击 run 就能够顺利爬取 2000 页的结果了,我这里一共抓取了 49,996 条结果,耗时 2 小时左右完成。

以上,就完成了数据的获取。有了数据我们就可以着手分析,不过这之前还需简单地进行一下数据的清洗、处理。

首先,我们需要从 MongoDB 中读取数据,并转换为 DataFrame。

1client = pymongo.MongoClient(host='localhost', port=27017)

2db = client['Huxiu']

3collection = db['huxiu_news']

4# 将数据库数据转为DataFrame

5data = pd.DataFrame(list(collection.find()))

下面我们看一下数据的总体情况,可以看到数据的维度是 49996 行 × 8 列。发现多了一列无用的 _id 需删除,同时 name 列有一些特殊符号,比如© 需删除。另外,数据格式全部为 Object 字符串格式,需要将 comment 和 favorites 两列更改为数值格式、 write_time 列更改为日期格式

1print(data.shape) # 查看行数和列数

2print(data.info()) # 查看总体情况

3print(data.head()) # 输出前5行

4

5# 结果:

6(49996, 8)

7Data columns (total 8 columns):

8_id 49996 non-null object

9abstract 49996 non-null object

10comment 49996 non-null object

11favorites 49996 non-null object

12name 49996 non-null object

13title 49996 non-null object

14url 49996 non-null object

15write_time 49996 non-null object

16dtypes: object(8)

17

18 _id abstract comment favorites name title url write_time

190 5bdc2 “在你们看到… 22 50 普象工业设计小站© 看了苹果屌 https:// 10小时前

201 5bdc2 中国”绿卡”号称“世界最难拿” 9 16 经济观察报© 递交材料厚 https:// 10小时前

212 5bdc2 鲜衣怒马少年时 2 13 小马宋 金庸小说陪 https:// 11小时前

223 5bdc2 预告还是预警? 3 10 Cuba Libre 阿里即将发 https:// 11小时前

234 5bdc2 库克:咋回事? 2 3 Cuba Libre 【虎嗅早报 https:// 11小时前

代码实现如下:

1# 删除无用_id列

2data.drop(['_id'],axis=1,inplace=True)

3# 替换掉特殊字符©

4data['name'].replace('©','',inplace=True,regex=True)

5# 字符更改为数值

6data = data.apply(pd.to_numeric,errors='ignore')

7# 更该日期格式

8data['write_time'] = data['write_time'].replace('.*前','2018-10-31',regex=True)

9# 为了方便,将write_time列,包含几小时前和几天前的行,都替换为10月31日最后1天。

10data['write_time'] = pd.to_datetime(data['write_time'])

下面,我们看一下数据是否有重复,如果有,那么需要删除。

1# 判断整行是否有重复值

2print(any(data.duplicated()))

3# 显示True,表明有重复值,进一步提取出重复值数量

4data_duplicated = data.duplicated().value_counts()

5print(data_duplicated) # 显示2 True ,表明有2个重复值

6# 删除重复值

7data = data.drop_duplicates(keep='first')

8# 删除部分行后,index中断,需重新设置index

9data = data.reset_index(drop=True)

10#结果:

11True

12False 49994

13True 2

然后,我们再增加两列数据,一列是文章标题长度列,一列是年份列,便于后面进行分析。

1data['title_length'] = data['title'].apply(len)

2data['year'] = data['write_time'].dt.year

3Data columns (total 9 columns):

4abstract 49994 non-null object

5comment 49994 non-null int64

6favorites 49994 non-null int64

7name 49994 non-null object

8title 49994 non-null object

9url 49994 non-null object

10write_time 49994 non-null datetime64[ns]

11title_length 49994 non-null int64

12year 49994 non-null int64

以上,就完成了基本的数据清洗处理过程,针对这 9 列数据可以开始进行分析了。

通常,数据分析主要分为四类: 「描述型分析」、「诊断型分析」「预测型分析」「规范型分析」。「描述型分析」是用来概括、表述事物整体状况以及事物间关联、类属关系的统计方法,是这四类中最为常见的数据分析类型。通过统计处理可以简洁地用几个统计值来表示一组数据地集中性(如平均值、中位数和众数等)和离散型(反映数据的波动性大小,如方差、标准差等)。

这里,我们主要进行描述性分析,数据主要为数值型数据(包括离散型变量和连续型变量)和文本数据。

先来看一下总体情况。

1print(data.describe())

2 comment favorites title_length

3count 49994.000000 49994.000000 49994.000000

4mean 10.860203 34.081810 22.775333

5std 24.085969 48.276213 9.540142

6min 0.000000 0.000000 1.000000

725% 3.000000 9.000000 17.000000

850% 6.000000 19.000000 22.000000

975% 12.000000 40.000000 28.000000

10max 2376.000000 1113.000000 224.000000

这里,使用了 data.describe() 方法对数值型变量进行统计分析。从上面可以简要得出以下几个结论:

读者的评论和收藏热情都不算太高。大部分文章(75 %)的评论数量为十几条,收藏数量不过几十个。这和一些微信大 V 公众号动辄百万级阅读、数万级评论和收藏量相比,虎嗅网的确相对小众一些。不过也正是因为小众,也才深得部分人的喜欢。

评论数最多的文章有 2376 条,收藏数最多的文章有 1113 个收藏量,说明还是有一些潜在的比较火或者质量比较好的文章。

最长的文章标题长达 224 个字,大部分文章标题长度在 20 来个字左右,所以 标题最好不要太长或过短。

对于非数值型变量(name、write_time),使用 describe() 方法会产生另外一种汇总统计。

1print(data['name'].describe())

2print(data['write_time'].describe())

3# 结果:

4count 49994

5unique 3162

6top 虎嗅

7freq 10513

8Name: name, dtype: object

9count 49994

10unique 2397

11top 2014-07-10 00:00:00

12freq 274

13first 2012-04-03 00:00:00

14last 2018-10-31 00:00:00

unique 表示唯一值数量,top 表示出现次数最多的变量,freq 表示该变量出现的次数,所以可以简单得出以下几个结论:

在文章来源方面,3162 个作者贡献了这 5 万篇文章,其中自家官网「虎嗅」写的数量最多,超过了 1 万篇,这也很自然。

在文章发表时间方面,最早的一篇文章来自于 2012年 4 月 3 日。 6 年多时间,发文数最多的 1 天 是 2014 年 7 月 10 日,一共发了 274 篇文章。

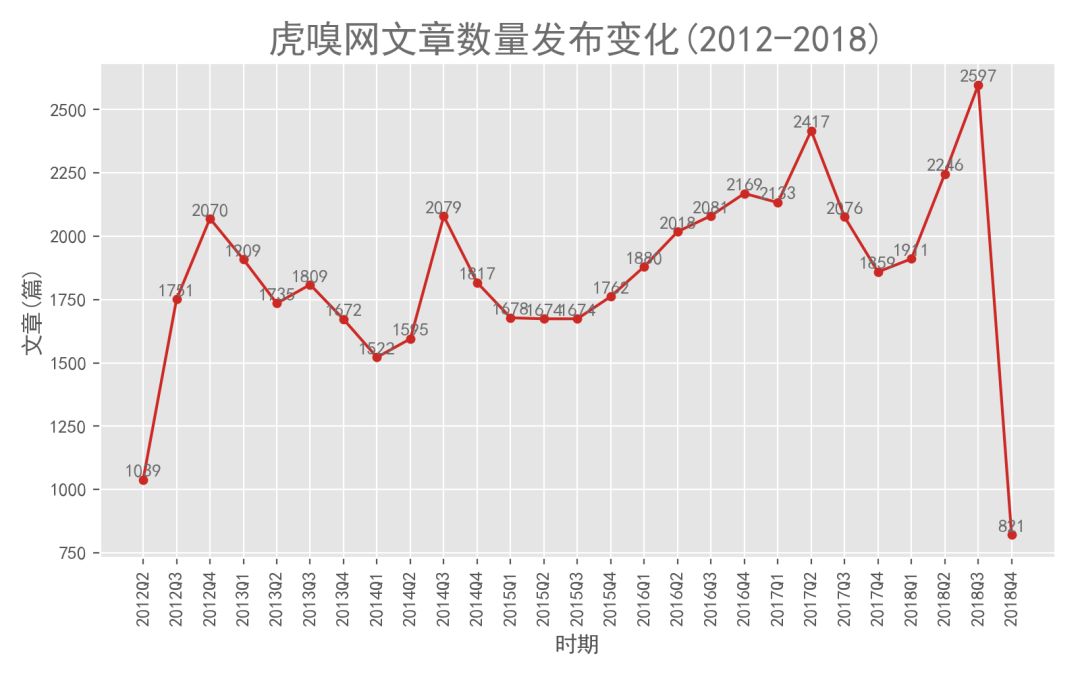

可以看到 ,以季度为时间尺度的 6 年间,前几年发文数量比较稳定,大概在1750 篇左右,个别季度数量激增到 2000 篇以上。2016 年之后文章开始增加到 2000 篇以上,可能跟网站知名度提升有关。首尾两个季度日期不全,所以数量比较少。

具体代码实现如下:

1def analysis1(data):

2 # # 汇总统计

3 # print(data.describe())

4 # print(data['name'].describe())

5 # print(data['write_time'].describe())

6

7 data.set_index(data['write_time'],inplace=True)

8 data = data.resample('Q').count()['name'] # 以季度汇总

9 data = data.to_period('Q')

10 # 创建x,y轴标签

11 x = np.arange(0,len(data),1)

12 ax1.plot(x,data.values, #x、y坐标

13 color = color_line , #折线图颜色为红色

14 marker = 'o',markersize = 4 #标记形状、大小设置

15 )

16 ax1.set_xticks(x) # 设置x轴标签为自然数序列

17 ax1.set_xticklabels(data.index) # 更改x轴标签值为年份

18 plt.xticks(rotation=90) # 旋转90度,不至太拥挤

19

20 for x,y in zip(x,data.values):

21 plt.text(x,y + 10,'%.0f' %y,ha = 'center',color = colors,

fontsize=fontsize_text )

22 # '%.0f' %y 设置标签格式不带小数

23 # 设置标题及横纵坐标轴标题

24 plt.title('虎嗅网文章数量发布变化(2012-2018)',color = colors,

fontsize=fontsize_title)

25 plt.xlabel('时期')

26 plt.ylabel('文章(篇)')

27 plt.tight_layout() # 自动控制空白边缘

28 plt.savefig('虎嗅网文章数量发布变化.png',dpi=200)

29 plt.show()

接下来,到了我们比较关心的问题:几万篇文章里,到底哪些文章写得比较好或者比较火?

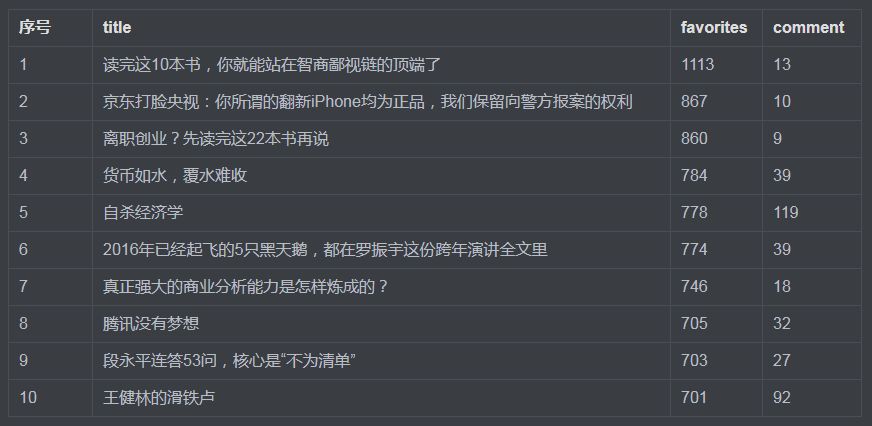

此处选取了「favorites」(收藏数量)作为衡量标准。毕竟,一般好的文章,我们都会有收藏的习惯。

第一名「读完这10本书,你就能站在智商鄙视链的顶端了 」以 1113 次收藏位居第一,并且遥遥领先于后者,看来大家都怀有「想早日攀上人生巅峰,一览众人小」的想法啊。打开这篇文章的链接,文中提到了这几本书:《思考,快与慢》、《思考的技术》、《麦肯锡入职第一课:让职场新人一生受用的逻辑思考力》等。一本都没看过,看来这辈子是很难登上人生巅峰了。

发现两个有意思的地方:

第一,文章标题都比较短小精炼。

第二,文章收藏量虽然比较高,但评论数都不多,猜测这是因为 大家都喜欢做伸手党?

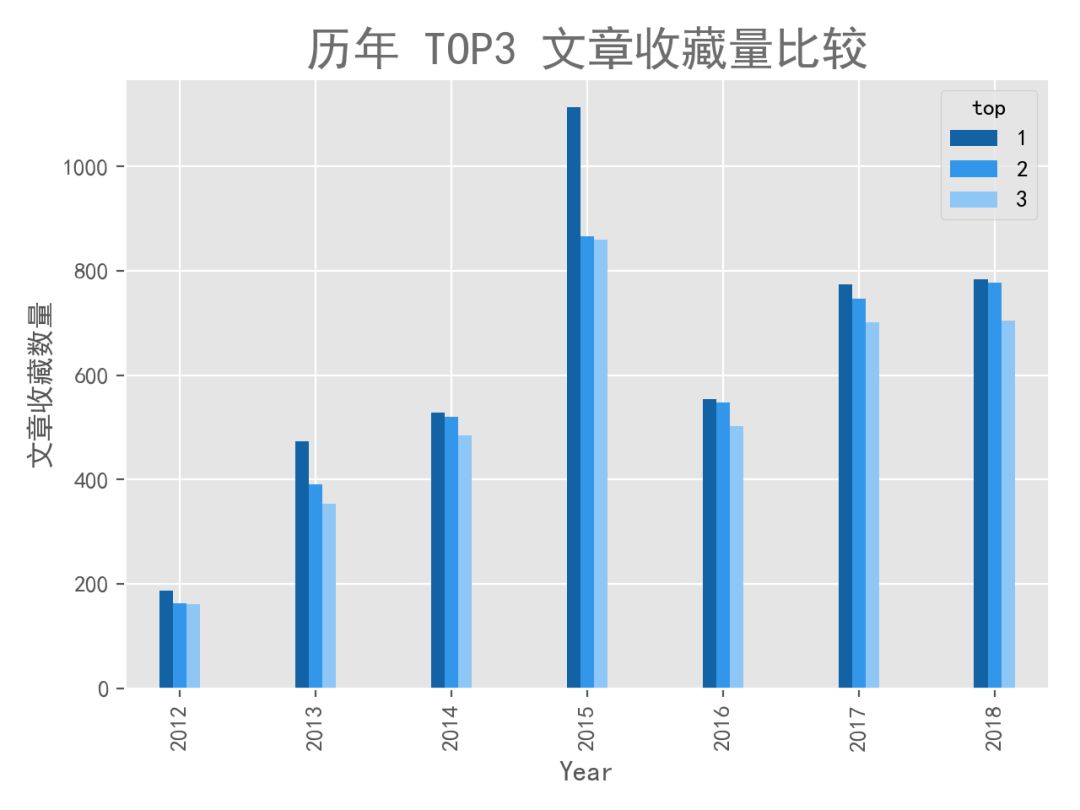

在了解文章的总体排名之后,我们来看看历年的文章排名是怎样的。这里,每年选取了收藏量最多的 3 篇文章。

可以看到,文章收藏量基本是逐年递增的,但 2015 年的 3 篇文章的收藏量却是最高的,包揽了总排名的前 3 名,不知道这一年的文章有什么特别之处。

以上只罗列了一小部分文章的标题,可以看到标题起地都蛮有水准的。关于标题的重要性,有这样通俗的说法:「一篇好文章,标题占一半」,一个好的标题可以大大增强文章的传播力和吸引力。文章标题虽只有短短数十字,但要想起好,里面也是很有很多技巧的。

好在,这里提供了 5 万个标题可供参考。

代码实现如下:

1def analysis2(data):

2 # # 总收藏排名

3 # top = data.sort_values(['favorites'],ascending = False)

4 # # 收藏前10

5 # top.index = (range(1,len(top.index)+1)) # 重置index,并从1开始编号

6 # print(top[:10][['title','favorites','comment']])

7

8 # 按年份排名

9 # # 增加一列年份列

10 # data['year'] = data['write_time'].dt.year

11 def topn(data):

12 top = data.sort_values('favorites',ascending=False)

13 return top[:3]

14 data = data.groupby(by=['year']).apply(topn)

15 print(data[['title','favorites']])

16 # 增加每年top123列,列依次值为1、2、3

17 data['add'] = 1 # 辅助

18 data['top'] = data.groupby(by='year')['add'].cumsum()

19 data_reshape = data.pivot_table(index='year',columns='top',values='favorites').

reset_index()

20 # print(data_reshape) # ok

21 data_reshape.plot(

22 # x='year',

23 y=[1,2,3],

24 kind='bar',

25 width=0.3,

26 color=['#1362A3','#3297EA','#8EC6F5'] # 设置不同的颜色

27 # title='虎嗅网历年收藏数最多的3篇文章'

28 )

29 plt.xlabel('Year')

30 plt.ylabel('文章收藏数量')

31 plt.title('历年 TOP3 文章收藏量比较',color = colors,fontsize=fontsize_title)

32 plt.tight_layout() # 自动控制空白边缘,以全部显示x轴名称

33 # plt.savefig('历年 Top3 文章收藏量比较.png',dpi=200)

34 plt.show()

上面,我们从收藏量指标进行了分析,下面,我们关注一下发布文章的作者(个人/媒体)。前面提到发文最多的是虎嗅官方,有一万多篇文章,这里我们筛除官媒,看看还有哪些比较高产的作者。

可以看到,前 20 名作者的发文量差距都不太大。发文比较多的有「娱乐资本论」、「Eastland」、「发条橙子」这类媒体号;也有虎嗅官网团队的作者:发条橙子、周超臣、张博文等;还有部分独立作者:假装FBI、孙永杰等。可以尝试关注一下这些高产作者。

可以看到,前 20 名作者的发文量差距都不太大。发文比较多的有「娱乐资本论」、「Eastland」、「发条橙子」这类媒体号;也有虎嗅官网团队的作者:发条橙子、周超臣、张博文等;还有部分独立作者:假装FBI、孙永杰等。可以尝试关注一下这些高产作者。

代码实现如下:

1def analysis3(data):

2 data = data.groupby(data['name'])['title'].count()

3 data = data.sort_values(ascending=False)

4 # pandas 直接绘制,.invert_yaxis()颠倒顺序

5 data[1:21].plot(kind='barh',color=color_line).invert_yaxis()

6 for y,x in enumerate(list(data[1:21].values)):

7 plt.text(x+12,y+0.2,'%s' %round(x,1),ha='center',color=colors)

8 plt.xlabel('文章数量')

9 plt.ylabel('作者')

10 plt.title('发文数量最多的 TOP20 作者',color = colors,fontsize=fontsize_title)

11 plt.tight_layout()

12 plt.savefig('发文数量最多的TOP20作者.png',dpi=200)

13 plt.show()

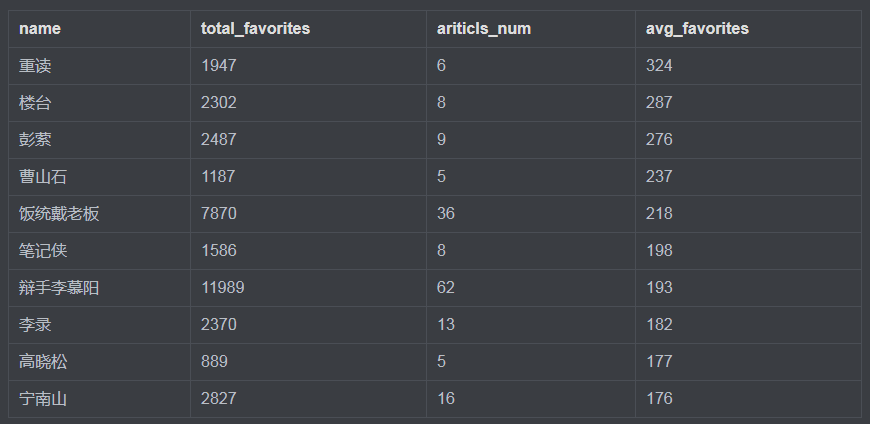

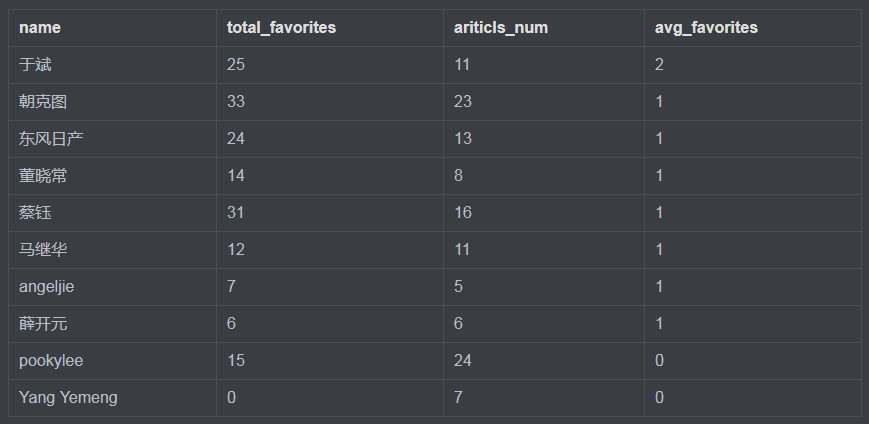

我们关注一个作者除了是因为文章高产以外,可能更看重的是其文章水准。这里我们选择「文章平均收藏量」(总收藏量/文章数)这个指标,来看看文章水准比较高的作者是哪些人。

这里,为了避免出现「某作者只写了一篇高收藏率的文章」这种不能代表其真实水准的情况,我们将筛选范围定在至少发布过 5 篇文章的作者们。

可以看到,前 10 名作者包括:遥遥领先的 重读、两位高产又有质量的 辩手李慕阳 和 饭统戴老板 ,还有大众比较熟悉的 高晓松、宁南山等。

如果你将这份名单和上面那份高产作者名单进行对比,会发现他们没有出现在这个名单中。相比于数量,质量可能更重要吧。

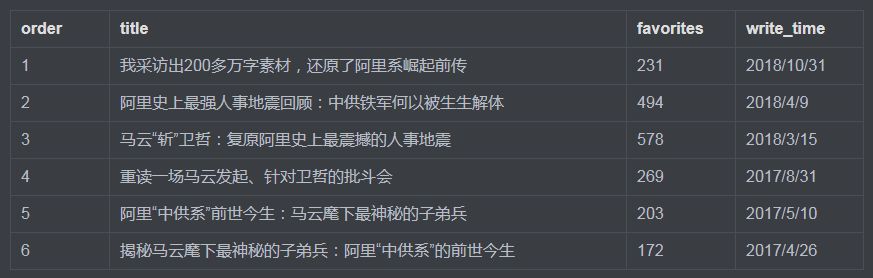

下面,我们就来看看排名第一的 重读 都写了哪些高收藏量文章。

居然写的都是清一色关于马老板家的文章。

了解了前十名作者之后,我们顺便也看看那些处于最后十名的都是哪些作者。

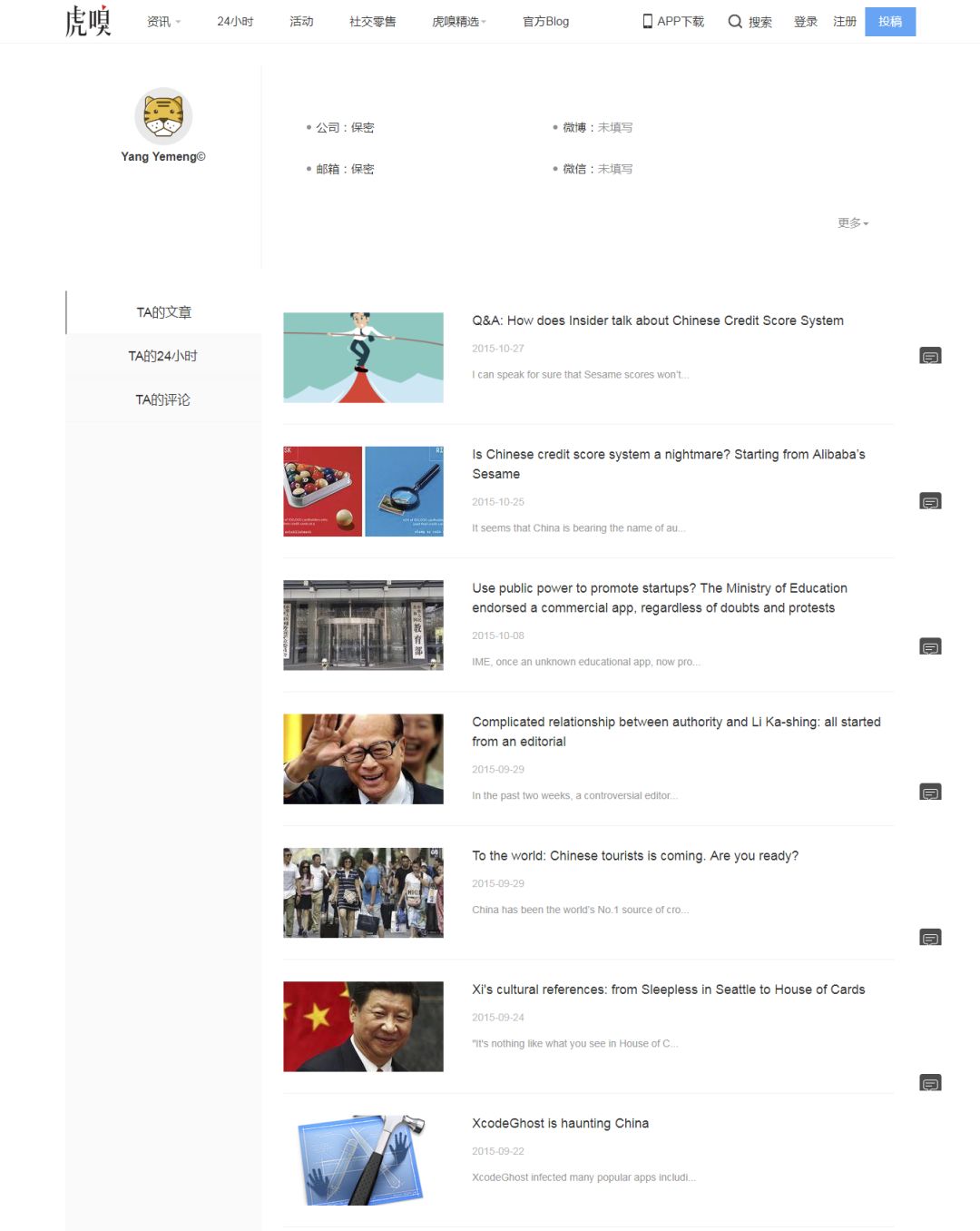

一对比,就能看到他们的文章收藏量就比较寒碜了。尤其好奇最后一位作者 Yang Yemeng ,他写了 7 篇文章,竟然一个收藏都没有。

来看看他究竟写了些什么文章。

原来写的全都是英文文章,看来大家并不太钟意阅读英文类的文章啊。

具体实现代码:

1def analysis4(data):

2 data = pd.pivot_table(data,values=['favorites'],index='name',

aggfunc=[np.sum,np.size])

3 data['avg'] = data[('sum','favorites')]/data[('size','favorites')]

4 # 平均收藏数取整

5 # data['avg'] = data['avg'].round(decimals=1)

6 data['avg'] = data['avg'].astype('int')

7 # flatten 平铺列

8 data.columns = data.columns.get_level_values(0)

9 data.columns = ['total_favorites','ariticls_num','avg_favorites']

10 # 筛选出文章数至少5篇的

11 data=data.query('ariticls_num > 4')

12 data = data.sort_values(by=['avg_favorites'],ascending=False)

13 # # 查看平均收藏率第一名详情

14 # data = data.query('name == "重读"')

15 # # 查看平均收藏率倒数第一名详情

16 # data = data.query('name == "Yang Yemeng"')

17 # print(data[['title','favorites','write_time']])

18 print(data[:10]) # 前10名

19 print(data[-10:]) # 后10名

说完了收藏量。下面,我们再来看看评论数量最多的文章是哪些。

基本上都是和 三星 有关的文章,这些文章大多来自 2014 年,那几年 三星 好像是挺火的,不过这两年国内基本上都见不到三星的影子了,世界变化真快。

发现了两个有意思的现象。

第一,上面关于 三星 和前面 阿里 的这些批量文章,它们「霸占」了评论和收藏榜,结合知乎上曾经的一篇关于介绍虎嗅这个网站的文章:虎嗅网其实是这样的 ,貌似能发现些微妙的事情。

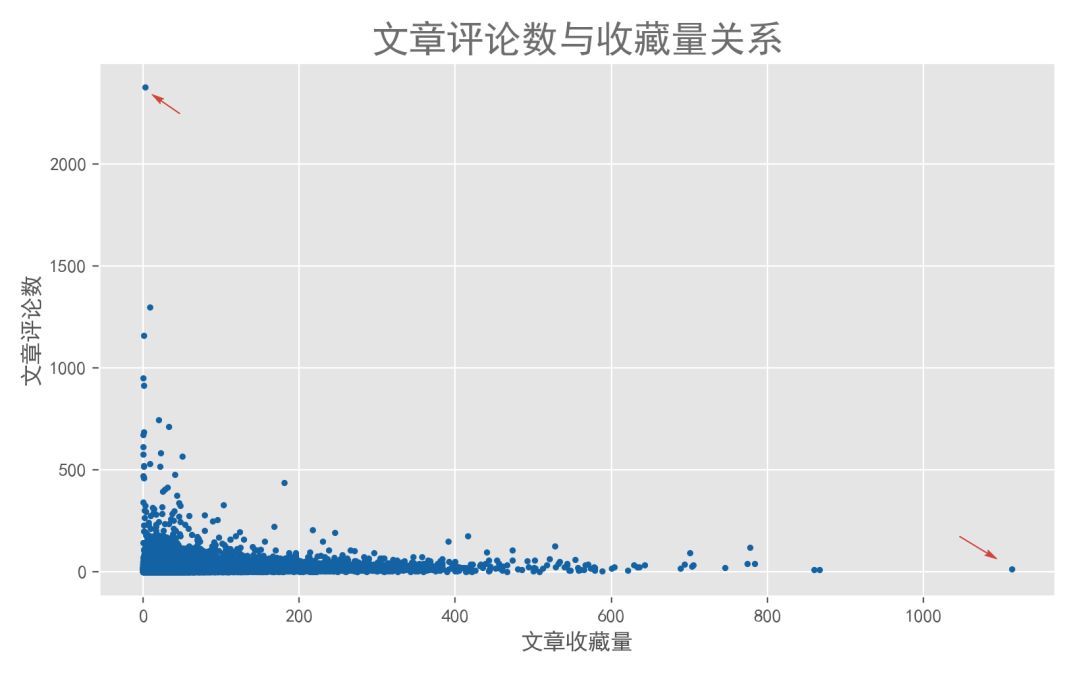

第二,这些文章评论数和收藏数两个指标几乎呈极端趋势,评论量多的文章收藏量却很少,评论量少的文章收藏量却很多。

我们进一步观察下这两个参数的关系。

可以看到,大多数点都位于左下角,意味着这些文章收藏量和评论数都比较低。但也存在少部分位于上方和右侧的异常值,表明这些文章呈现 「多评论、少收藏」或者「少评论、多收藏」的特点。

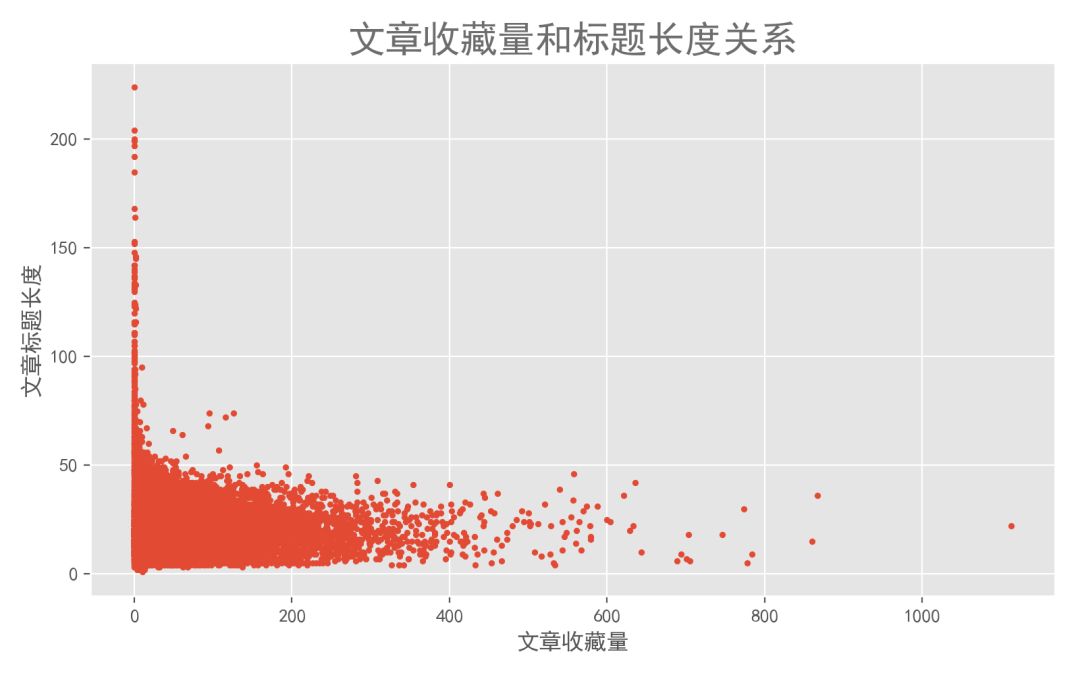

下面,我们再来看看文章标题的长度和收藏量之间有没有什么关系。

大致可以看出两点现象:

第一,收藏量高的文章,他们的标题都比较短(右侧的部分散点)。

第二,标题很长的文章,它们的收藏量都非常低(左边形成了一条垂直线)。

看来,文章起标题时最好不要起太长的。

实现代码如下:

1def analysis5(data):

2 plt.scatter(

3 x=data['favorites'],

4 y =data['comment'],

5 s=data['title_length']/2,

6 )

7 plt.xlabel('文章收藏量')

8 plt.ylabel('文章评论数')

9 plt.title('文章标题长度与收藏量和评论数之间的关系',color = colors,

fontsize=fontsize_title)

10 plt.tight_layout()

11 plt.show()

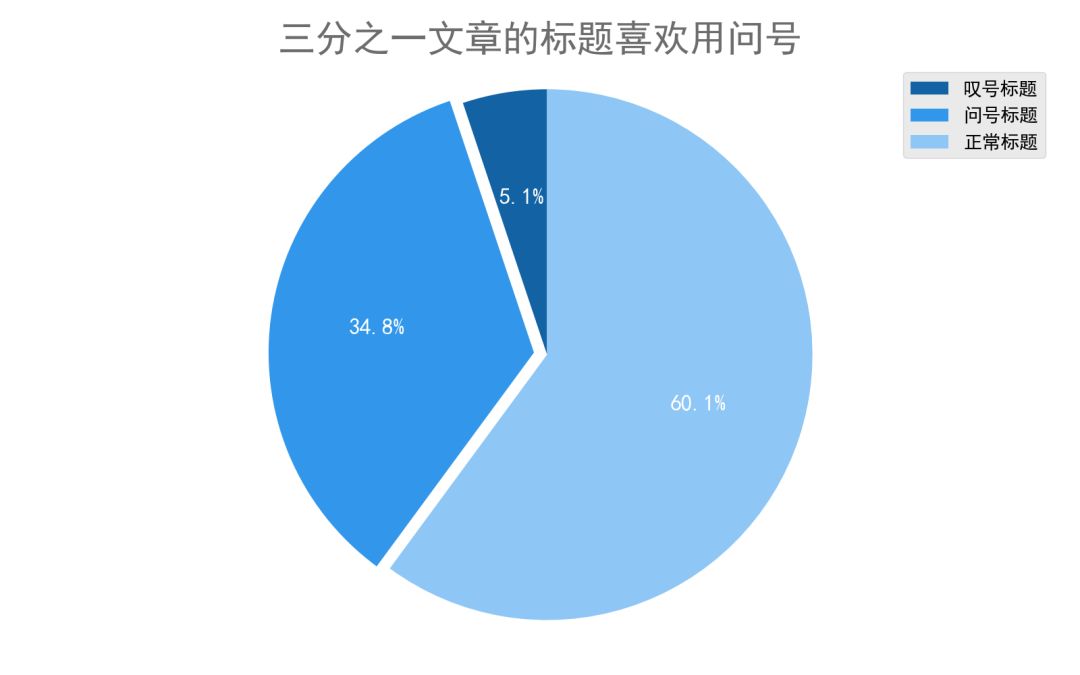

下面,我们看看作者在起文章标题的时候,在标点符号方面有没有什么偏好。

可以看到,五万篇文章中,大多数文章的标题是陈述性标题。三分之一(34.8%) 的文章标题使用了问号「?」,而仅有 5% 的文章用了叹号「!」。通常,问号会让人们产生好奇,从而想去点开文章;而叹号则会带来一种紧张或者压迫感,使人不太想去点开。所以,可以尝试多用问号而少用叹号。

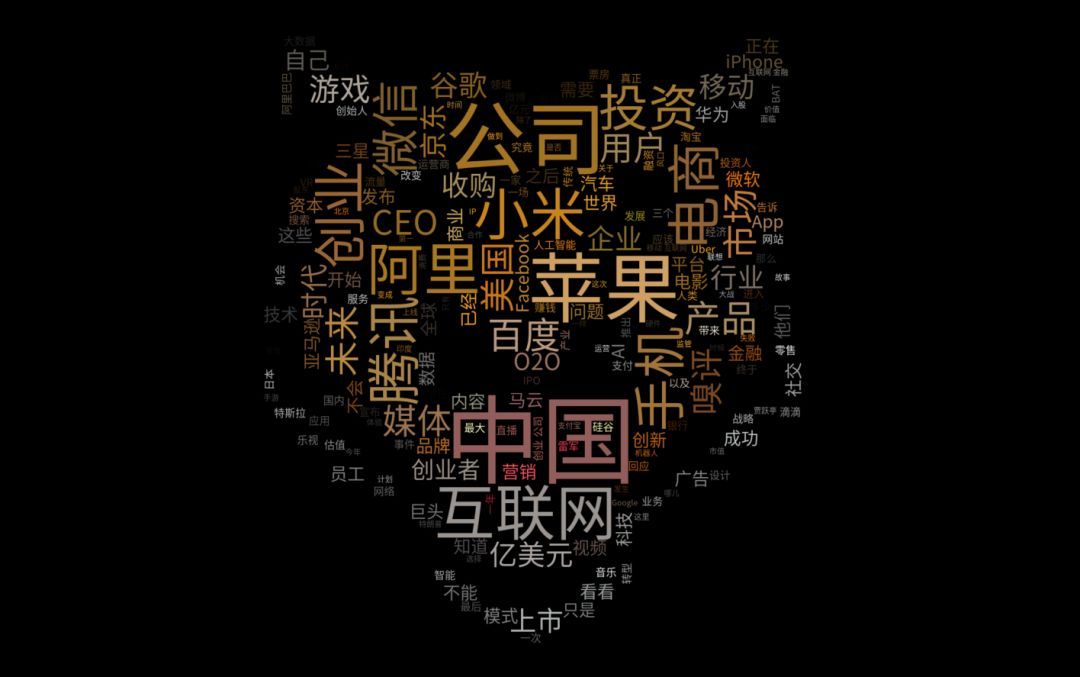

最后,我们从这 5 万篇文章中的标题和摘要中,来看看虎嗅网的文章主要关注的都是哪些主题领域。

这里首先运用了 jieba 分词包对标题进行了分词,然后用 WordCloud 做成了词云图,因虎嗅网含有「虎」字,故选取了一张老虎头像。(关于 jieba 和 WordCloud 两个包,之后再详细介绍)

可以看到文章的主题内容侧重于:互联网、知名公司、电商、投资这些领域。这和网站本身对外宣传的核心内容,即「关注互联网与移动互联网一系列明星公司的起落轨迹、产业潮汐的动力与趋势,以及互联网与移动互联网如何改造传统产业」大致相符合。

实现代码如下:

1def analysis6(data):

2 text=''

3 for i in data['title'].values:

4 symbol_to_replace = '[!"#$%&\'()*+,-./:;<=>?@,。?★、…【】《》?

“”‘’![\\]^_`{|}~]+'

5 i = re.sub(symbol_to_replace,'',i)

6 text+=' '.join(jieba.cut(i,cut_all=False))

7 d = path.dirname(__file__) if "__file__" in locals() else os.getcwd()

8

9 background_Image = np.array(Image.open(path.join(d, "tiger.png")))

10 font_path = 'C:\Windows\Fonts\SourceHanSansCN-Regular.otf' # 思源黑字体

11

12 # 添加stopswords

13 stopwords = set()

14 # 先运行对text进行词频统计再排序,再选择要增加的停用词

15 stopwords.update(['如何','怎么','一个','什么','为什么','还是','我们','为何',

'可能','不是','没有','哪些','成为','可以','背后','到底','就是','这么','不要','怎样','为了',

'能否','你们','还有','这样','这个','真的','那些'])

16 wc = WordCloud(

17 background_color = 'black',

18 font_path = font_path,

19 mask = background_Image,

20 stopwords = stopwords,

21 max_words = 200,

22 margin =2,

23 max_font_size = 100,

24 random_state = 42,

25 scale = 2,

26 )

27 wc.generate_from_text(text)

28 process_word = WordCloud.process_text(wc, text)

29 # 下面是字典排序

30 sort = sorted(process_word.items(),key=lambda e:e[1],reverse=True) # sort

为list

31 print(sort[:50]) # 输出前词频最高的前50个,然后筛选出不需要的stopwords,

添加到前面的stopwords.update()方法中

32 img_colors = ImageColorGenerator(background_Image)

33 wc.recolor(color_func=img_colors) # 颜色跟随图片颜色

34 plt.imshow(wc,interpolation='bilinear')

35 plt.axis('off')

36 plt.tight_layout() # 自动控制空白边缘

37 plt.savefig('huxiu20.png',dpi=200)

38 plt.show()

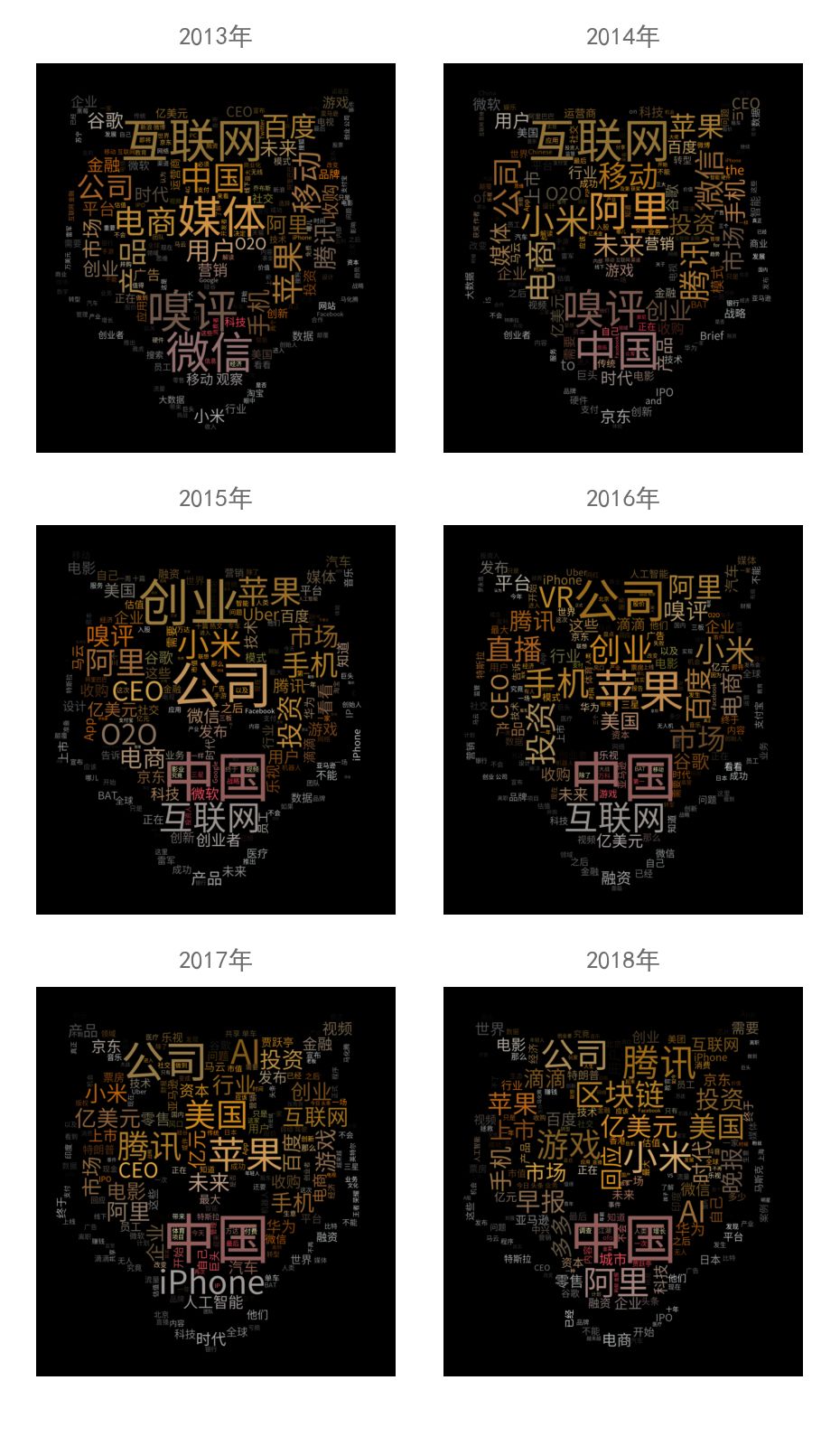

上面的关键词是这几年总体的概况,而科技互联网行业每年的发展都是不同的,所以,我们再来看看历年的一些关键词,透过这些关键词看看这几年互联网行业、科技热点、知名公司都有些什么不同变化。

可以看到每年的关键词都有一些相同之处,但也不同的地方:

中国互联网、公司、苹果、腾讯、阿里等这些热门关键词一直都是热门,这几家公司真是稳地一批啊。

每年会有新热点涌现:比如 2013 年的微信(刚开始火)、2016 年的直播(各大直播平台如雨后春笋般出现)、2017年的 iPhone(上市十周年)、2018年的小米(上市)。

不断有新的热门技术出现:2013 - 2015 年的 O2O、2016 年的 VR、2017 年的 AI 、2018 年的「区块链」。这些科技前沿技术也是这几年大家口耳相传的热门词汇。

通过这一幅图,就看出了这几年科技互联网行业、明星公司、热点信息的风云变化。

本文简要分析了虎嗅网 5 万篇文章信息,大致了解了近些年科技互联网的千变万化。

发掘了那些优秀的文章和作者,能够节省宝贵的时间成本。

一篇文章要想传播广泛,文章本身的质量和标题各占一半,文中的5 万个标题相信能够带来一些灵感。

本文尚未做深入的文本挖掘,而文本挖掘可能比数据挖掘涵盖的信息量更大,更有价值。进行这些分析需要机器学习和深度学习的知识,待后期学习后再来补充。

本文为作者独立观点,不代表鸟哥笔记立场,未经允许不得转载。

《鸟哥笔记版权及免责申明》 如对文章、图片、字体等版权有疑问,请点击 反馈举报

Powered by QINGMOB PTE. LTD. © 2010-2025 上海青墨信息科技有限公司 沪ICP备2021034055号-6

我们致力于提供一个高质量内容的交流平台。为落实国家互联网信息办公室“依法管网、依法办网、依法上网”的要求,为完善跟帖评论自律管理,为了保护用户创造的内容、维护开放、真实、专业的平台氛围,我们团队将依据本公约中的条款对注册用户和发布在本平台的内容进行管理。平台鼓励用户创作、发布优质内容,同时也将采取必要措施管理违法、侵权或有其他不良影响的网络信息。

一、根据《网络信息内容生态治理规定》《中华人民共和国未成年人保护法》等法律法规,对以下违法、不良信息或存在危害的行为进行处理。

1. 违反法律法规的信息,主要表现为:

1)反对宪法所确定的基本原则;

2)危害国家安全,泄露国家秘密,颠覆国家政权,破坏国家统一,损害国家荣誉和利益;

3)侮辱、滥用英烈形象,歪曲、丑化、亵渎、否定英雄烈士事迹和精神,以侮辱、诽谤或者其他方式侵害英雄烈士的姓名、肖像、名誉、荣誉;

4)宣扬恐怖主义、极端主义或者煽动实施恐怖活动、极端主义活动;

5)煽动民族仇恨、民族歧视,破坏民族团结;

6)破坏国家宗教政策,宣扬邪教和封建迷信;

7)散布谣言,扰乱社会秩序,破坏社会稳定;

8)宣扬淫秽、色情、赌博、暴力、凶杀、恐怖或者教唆犯罪;

9)煽动非法集会、结社、游行、示威、聚众扰乱社会秩序;

10)侮辱或者诽谤他人,侵害他人名誉、隐私和其他合法权益;

11)通过网络以文字、图片、音视频等形式,对未成年人实施侮辱、诽谤、威胁或者恶意损害未成年人形象进行网络欺凌的;

12)危害未成年人身心健康的;

13)含有法律、行政法规禁止的其他内容;

2. 不友善:不尊重用户及其所贡献内容的信息或行为。主要表现为:

1)轻蔑:贬低、轻视他人及其劳动成果;

2)诽谤:捏造、散布虚假事实,损害他人名誉;

3)嘲讽:以比喻、夸张、侮辱性的手法对他人或其行为进行揭露或描述,以此来激怒他人;

4)挑衅:以不友好的方式激怒他人,意图使对方对自己的言论作出回应,蓄意制造事端;

5)羞辱:贬低他人的能力、行为、生理或身份特征,让对方难堪;

6)谩骂:以不文明的语言对他人进行负面评价;

7)歧视:煽动人群歧视、地域歧视等,针对他人的民族、种族、宗教、性取向、性别、年龄、地域、生理特征等身份或者归类的攻击;

8)威胁:许诺以不良的后果来迫使他人服从自己的意志;

3. 发布垃圾广告信息:以推广曝光为目的,发布影响用户体验、扰乱本网站秩序的内容,或进行相关行为。主要表现为:

1)多次发布包含售卖产品、提供服务、宣传推广内容的垃圾广告。包括但不限于以下几种形式:

2)单个帐号多次发布包含垃圾广告的内容;

3)多个广告帐号互相配合发布、传播包含垃圾广告的内容;

4)多次发布包含欺骗性外链的内容,如未注明的淘宝客链接、跳转网站等,诱骗用户点击链接

5)发布大量包含推广链接、产品、品牌等内容获取搜索引擎中的不正当曝光;

6)购买或出售帐号之间虚假地互动,发布干扰网站秩序的推广内容及相关交易。

7)发布包含欺骗性的恶意营销内容,如通过伪造经历、冒充他人等方式进行恶意营销;

8)使用特殊符号、图片等方式规避垃圾广告内容审核的广告内容。

4. 色情低俗信息,主要表现为:

1)包含自己或他人性经验的细节描述或露骨的感受描述;

2)涉及色情段子、两性笑话的低俗内容;

3)配图、头图中包含庸俗或挑逗性图片的内容;

4)带有性暗示、性挑逗等易使人产生性联想;

5)展现血腥、惊悚、残忍等致人身心不适;

6)炒作绯闻、丑闻、劣迹等;

7)宣扬低俗、庸俗、媚俗内容。

5. 不实信息,主要表现为:

1)可能存在事实性错误或者造谣等内容;

2)存在事实夸大、伪造虚假经历等误导他人的内容;

3)伪造身份、冒充他人,通过头像、用户名等个人信息暗示自己具有特定身份,或与特定机构或个人存在关联。

6. 传播封建迷信,主要表现为:

1)找人算命、测字、占卜、解梦、化解厄运、使用迷信方式治病;

2)求推荐算命看相大师;

3)针对具体风水等问题进行求助或咨询;

4)问自己或他人的八字、六爻、星盘、手相、面相、五行缺失,包括通过占卜方法问婚姻、前程、运势,东西宠物丢了能不能找回、取名改名等;

7. 文章标题党,主要表现为:

1)以各种夸张、猎奇、不合常理的表现手法等行为来诱导用户;

2)内容与标题之间存在严重不实或者原意扭曲;

3)使用夸张标题,内容与标题严重不符的。

8.「饭圈」乱象行为,主要表现为:

1)诱导未成年人应援集资、高额消费、投票打榜

2)粉丝互撕谩骂、拉踩引战、造谣攻击、人肉搜索、侵犯隐私

3)鼓动「饭圈」粉丝攀比炫富、奢靡享乐等行为

4)以号召粉丝、雇用网络水军、「养号」形式刷量控评等行为

5)通过「蹭热点」、制造话题等形式干扰舆论,影响传播秩序

9. 其他危害行为或内容,主要表现为:

1)可能引发未成年人模仿不安全行为和违反社会公德行为、诱导未成年人不良嗜好影响未成年人身心健康的;

2)不当评述自然灾害、重大事故等灾难的;

3)美化、粉饰侵略战争行为的;

4)法律、行政法规禁止,或可能对网络生态造成不良影响的其他内容。

二、违规处罚

本网站通过主动发现和接受用户举报两种方式收集违规行为信息。所有有意的降低内容质量、伤害平台氛围及欺凌未成年人或危害未成年人身心健康的行为都是不能容忍的。

当一个用户发布违规内容时,本网站将依据相关用户违规情节严重程度,对帐号进行禁言 1 天、7 天、15 天直至永久禁言或封停账号的处罚。当涉及欺凌未成年人、危害未成年人身心健康、通过作弊手段注册、使用帐号,或者滥用多个帐号发布违规内容时,本网站将加重处罚。

三、申诉

随着平台管理经验的不断丰富,本网站出于维护本网站氛围和秩序的目的,将不断完善本公约。

如果本网站用户对本网站基于本公约规定做出的处理有异议,可以通过「建议反馈」功能向本网站进行反馈。

(规则的最终解释权归属本网站所有)